1. Định nghĩa Big Data

Như đã nói ở trên, Big Data (“dữ liệu lớn”) là tập hợp dữ liệu có dung lượng vượt mức đảm đương của những ứng dụng và công cụ truyền thống. Kích cỡ của Big Data đang từng ngày tăng lên, và tính đến năm 2012 thì nó có thể nằm trong khoảng vài chục terabyte cho đến nhiều petabyte (1 petabyte = 1024 terabyte) chỉ cho một tập hợp dữ liệu mà thôi.

Vào năm 2001, nhà phân tích Doug Laney của hãng META Group (bây giờ chính là công ty nghiên cứu Gartner) đã nói rằng những thách thức và cơ hội nằm trong việc tăng trưởng dữ liệu có thể được mô tả bằng ba chiều: tăng về lượng (volume), tăng về vận tốc (velocity) và tăng về chủng loại (variety). Giờ đây, Gartner cùng với nhiều công ty và tổ chức khác trong lĩnh vực công nghệ thông tin tiếp tục sử dụng mô hình “3V” này để định nghĩa nên Big Data. Đến năm 2012, Gartner bổ sung thêm rằng Big Data ngoài ba tính chất trên thì còn phải “cần đến các dạng xử lí mới để giúp đỡ việc đưa ra quyết định, khám phá sâu vào sự vật/sự việc và tối ưu hóa các quy trình làm việc”.

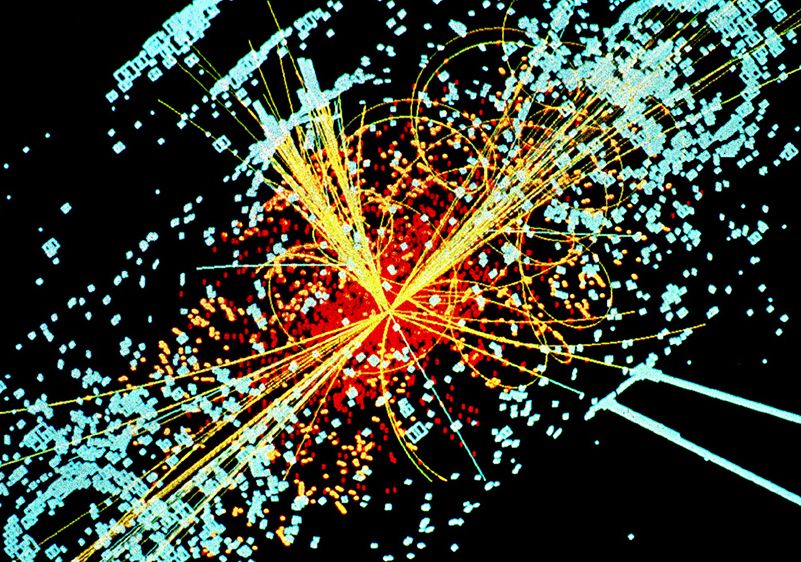

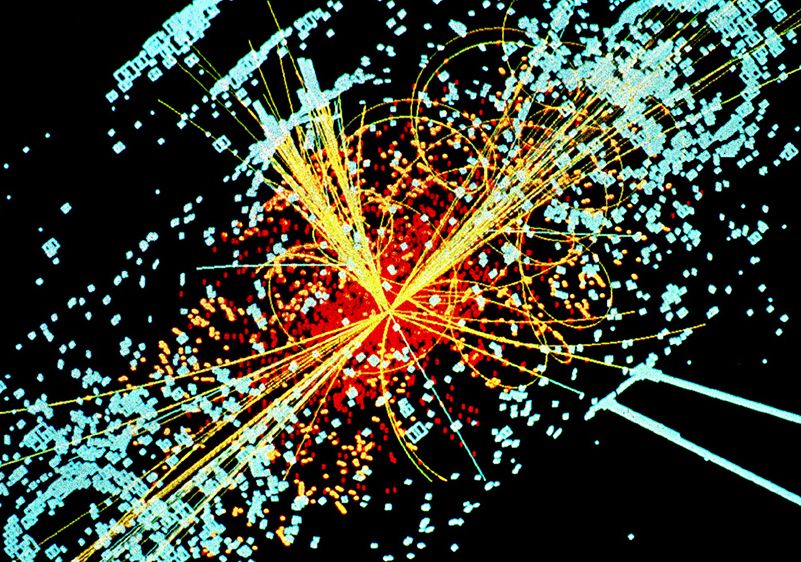

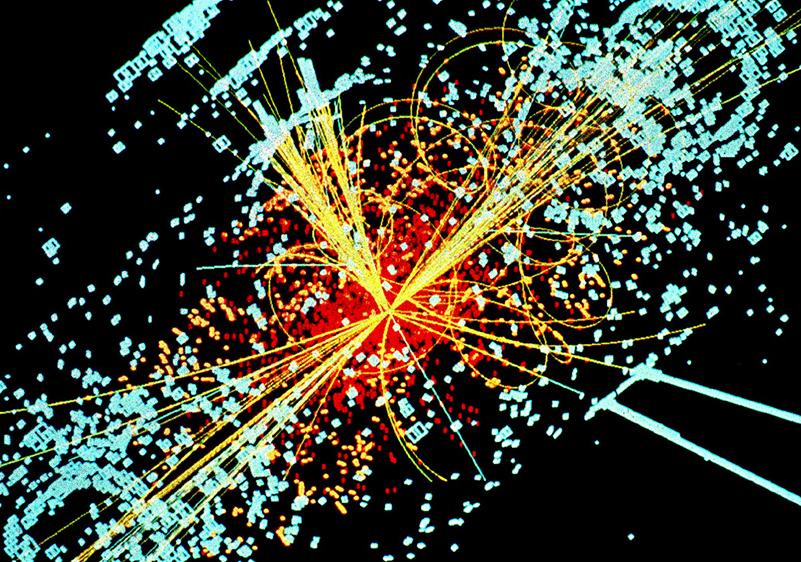

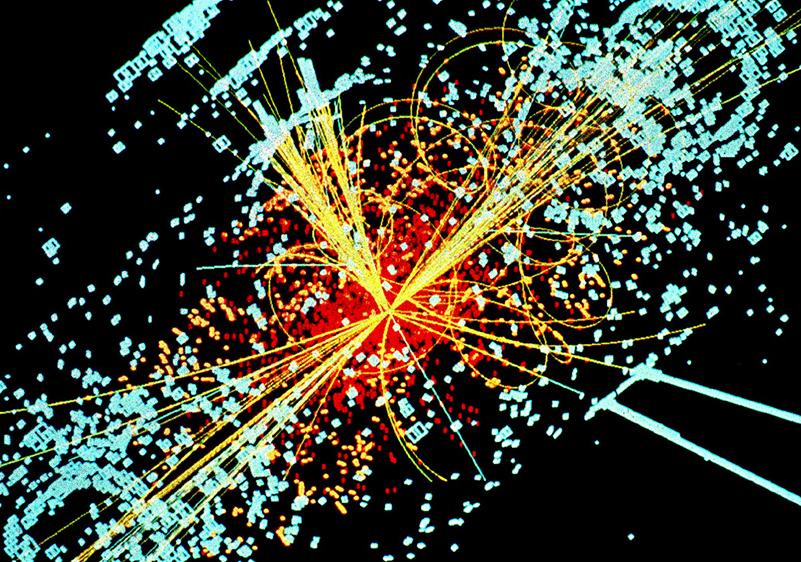

Chúng ta có thể lấy các thí nghiệm của Máy gia tốc hạt lớn (LHC) ở Châu Âu làm ví dụ cho Big Data. Khi các thí nghiệm này được tiến hành, kết quả sẽ được ghi nhận bởi 150 triệu cảm biến với nhiệm vụ truyền tải dữ liệu khoảng 40 triệu lần mỗi giây. Kết quả là nếu như LHC ghi nhận hết kết quả từ mọi cảm biến thì luồng dữ liệu sẽ trở nên vô cùng lớn, có thể đạt đến 150 triệu petabyte mỗi năm, hoặc 500 exabyte mỗi ngày, cao hơn 200 lần so với tất cả các nguồn dữ liệu khác trên thế giới gộp loại.

Đây là kết quả mô phỏng của một vụ va chạm giữa các hạt sơ cấp trong máy gia tốc LHC, có rất rất nhiều thông tin cần phải ghi nhận trong mỗi vụ chạm như thế này

Trong mỗi giây như thế lại có đến khoảng 600 triệu vụ va chạm giữa các hạt vật chất diễn ra, nhưng sau khi chọn lọc lại từ khoảng 99,999% các luồng dữ liệu đó, chỉ có tầm 100 vụ va chạm là được các nhà khoa học quan tâm. Điều này có nghĩa là cơ quan chủ quản LHC phải tìm những biện pháp mới để quản lý và xử lí hết mớ dữ liệu khổng lồ này.

Một ví dụ khác, khi Sloan Digital Sky Sruver, một trạm quan sát vũ trụ đặt tại New Mexico, bắt đầu đi vào hoạt động hồi năm 2000, sau một vài tuần nó đã thu thập Big Data hơn tổng lượng dữ liệu mà ngành thiên văn học đã từng thu thập trong quá khứ, khoảng 200GB mỗi đêm và hiện tổng dung lượng đã đạt đến hơn 140 terabyte. Đài quan sát LSST để thay thế cho SDSS dự kiến khánh thành trong năm 2016 thì sẽ thu thập lượng dữ liệu tương đương như trên nhưng chỉ trong vòng 5 ngày.

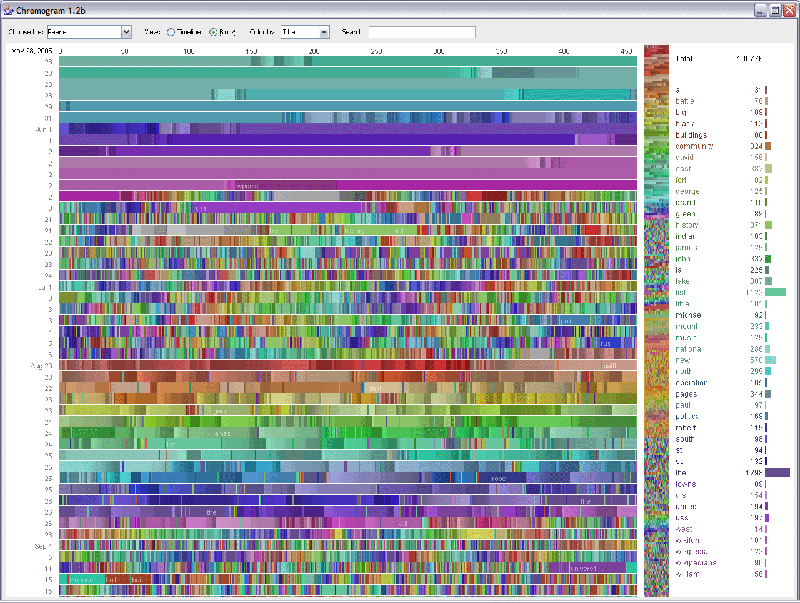

Hoặc như công tác giải mã di truyền của con người chẳng hạn. Trước đây công việc này mất đến 10 năm để xử lí, còn bây giờ người ta chỉ cần một tuần là đã hoàn thành. Còn Trung tâm giả lập khí hậu của NASA thì đang chứa 32 petabyte dữ liệu về quan trắc thời tiết và giả lập trong siêu máy tính của họ. Việc lưu trữ hình ảnh, văn bản và các nội dung đa phương tiện khác trên Wikipedia cũng như ghi nhận hành vi chỉnh sửa của người dùng cũng cấu thành một tập hợp Big Data lớn.

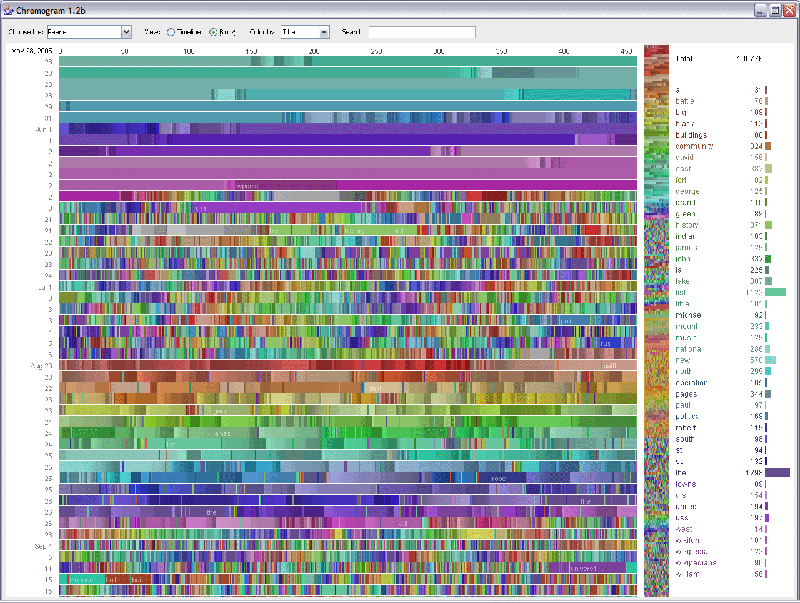

Hoạt động của người dùng Wikipedia được mô hình hóa và với kích thước hàng terabyte, đây cũng có thể được xem là một dạng Big Data

2. Vài thông tin về tình hình Big Data hiện nay

Theo tài liệu của Intel vào tháng 9/2013, hiện nay thế giới đang tạo ra 1 petabyte dữ liệu trong mỗi 11 giây và nó tương đương với một đoạn video HD dài 13 năm. Bản thân các công ty, doanh nghiệp cũng đang sở hữu Big Data của riêng mình, chẳng hạn như trang bán hàng trực tuyến eBay thì sử dụng hai trung tâm dữ liệu với dung lượng lên đến 40 petabyte để chứa những truy vấn, tìm kiếm, đề xuất cho khách hàng cũng như thông tin về hàng hóa của mình.

Nhà bán lẻ online Amazon.com thì phải xử lí hàng triệu hoạt động mỗi ngày cũng như những yêu cầu từ khoảng nửa triệu đối tác bán hàng. Amazon sử dụng một hệ thống Linux và hồi năm 2005, họ từng sở hữu ba cơ sở dữ liệu Linux lớn nhất thế giới với dung lượng là 7,8TB, 18,5TB và 24,7TB.

Tương tự, Facebook cũng phải quản lí 50 tỉ bức ảnh từ người dùng tải lên, YouTube hay Google thì phải lưu lại hết các lượt truy vấn và video của người dùng cùng nhiều loại thông tin khác có liên quan.

Còn theo tập đoàn SAS, chúng ta có một vài số liệu thú vị về Big Data như sau:

· Các hệ thống RFID (một dạng kết nối tầm gần, như kiểu NFC nhưng có tầm hoạt động xa hơn và cũng là thứ dùng trong thẻ mở cửa khách sạn) tạo ra lượng dữ liệu lớn hơn 1.000 lần so với mã vạc truyền thống

· Chỉ trong vòng 4 giờ của ngày “Black Friday” năm 2012, cửa hàng Walmart đã phải xử lí hơn 10 triệu giao dịch tiền mặt, tức là khoản 5.000 giao diện mỗi giây.

· Dịch vụ chuyển phát UPS nhận khoảng 39,5 triệu yêu cầu từ khách hàng của mình mỗi ngày

· Dịch vụ thẻ VISA xử lí hơn 172.800.000 giao dịch thẻ chỉ trong vòng một ngày mà thôi

· Trên Twitter có 500 triệu dòng tweet mới mỗi ngày, Facebook thì có 1,15 tỉ thành viên tạo ra một mớ khổng lồ dữ liệu văn bản, tập tin, video…

3. Công nghệ dùng trong Big Data

Big Data là nhu cầu đang tăng trưởng lớn đến nỗi Software AG, Oracle, IBM, Microsoft, SAP, EMC, HP và Dell đã chi hơn 15 tỉ USD cho các công ty chuyên về quản lí và phân tích dữ liệu. Năm 2010, ngành công nghiệp Big Data có giá trị hơn 100 tỉ USD và đang tăng nhanh với tốc độ 10% mỗi năm, nhanh gấp đôi so với tổng ngành phần mềm nói chung.

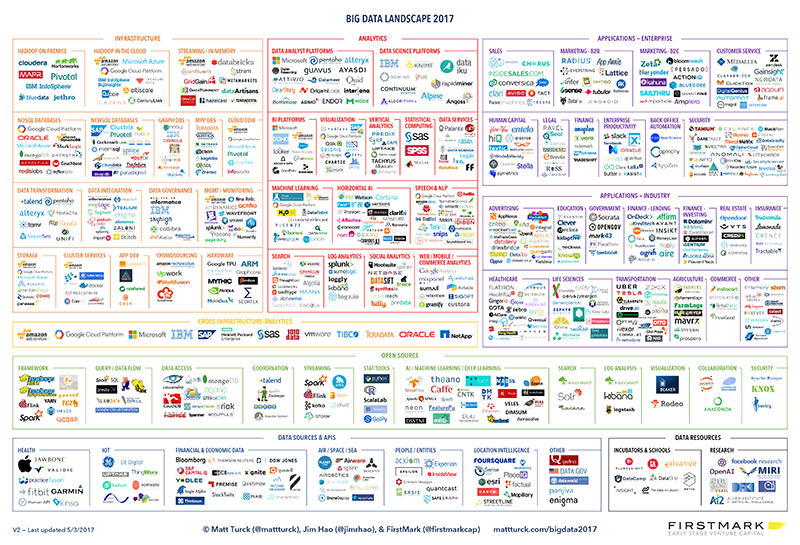

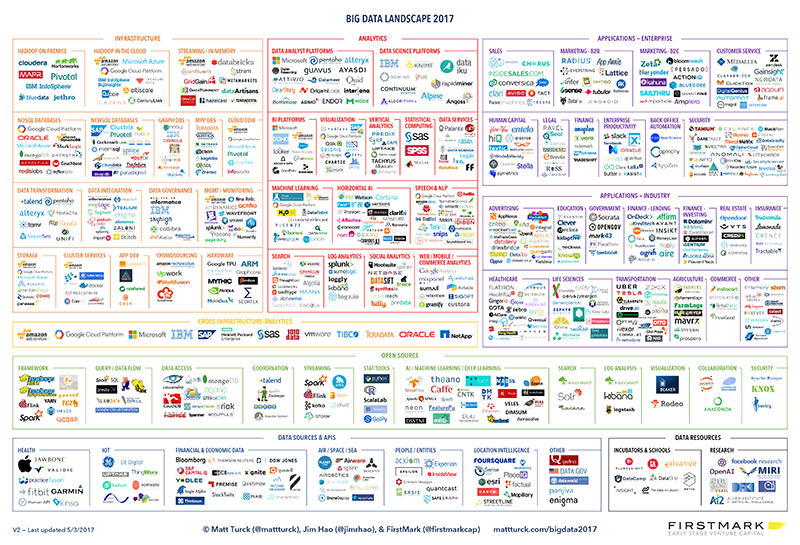

Tổng quan về thị trường các công ty có tham gia vào lĩnh vực Big Data năm 2017

Như đã nói ở trên, Big Data cần đến các kĩ thuật khai thác thông tin rất đặc biệt do tính chất khổng lồ và phức tạp của nó. Năm 2011, tập đoàn phân tích McKinsey đề xuất những công nghệ có thể dùng với Big Data bao gồm crowsourcing (tận dụng nguồn lực từ nhiều thiết bị điện toán trên toàn cầu để cùng nhau xử lí dữ liệu), các thuật toán về gen và di truyền, những biện pháp machine learning (ý chỉ các hệ thống có khả năng học hỏi từ dữ liệu, một nhánh của trí tuệ nhân tạo), xử lí ngôn ngữ tự nhiên (giống như Siri hay Google Voice Search, nhưng cao cấp hơn), xử lí tín hiệu, mô phỏng, phân tích chuỗi thời gian, mô hình hóa, kết hợp các server mạnh lại với nhau.... Những kĩ thuật này rất phức tạp nên chúng ta không đi sâu nói về chúng.

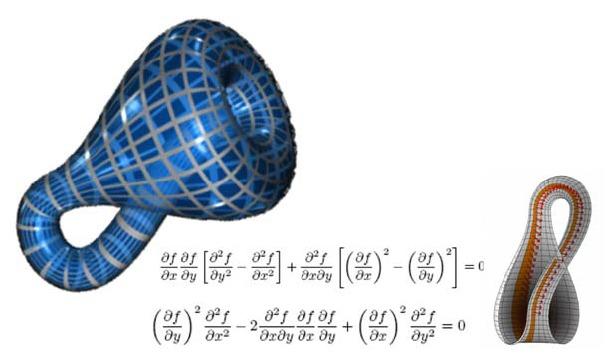

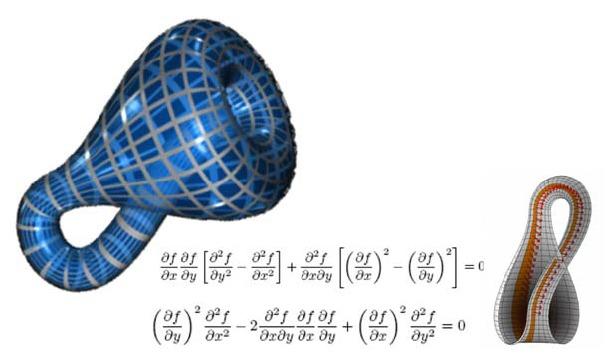

Một trong những mô hình về cấu trúc cơ bản của một tập hợp dữ liệu rất lớn do bộ phận nghiên cứu của Bộ quốc phòng Mỹ đưa ra

Ngoài ra, các cơ sở dữ liệu hỗ trợ xử lí dữ liệu song song, ứng dụng hoạt động dựa trên hoạt động tìm kiếm, file system dạng rời rạc, các hệ thống điện toán đám mây (bao gồm ứng dụng, nguồn lực tính toán cũng như không gian lưu trữ) và bản thân Internet cũng là những công cụ đắc lực phục vụ cho công tác nghiên cứu và trích xuất thông tin từ “dữ liệu lớn”. Hiện nay cũng có vài cơ sở dữ liệu theo dạng quan hệ (bảng) có khả năng chứa hàng petabyte dữ liệu, chúng cũng có thể tải, quản lí, sao lưu và tối ưu hóa cách sử dụng Big Data nữa.

Những người làm việc với Big Data thường cảm tháy khó chịu với các hệ thống lưu trữ dữ liệu vì tốc độ chậm, do đó họ thích những loại ổ lưu trữ nào có thể gắn trực tiếp vào máy tính (cũng như ổ cứng gắn trong máy tính của chúng ta vậy). Ổ đó có thể là SSD cho đến các đĩa SATA nằm trong một lưới lưu trữ cỡ lớn. Những người này nhìn vào ổ NAS hay hệ thống lưu trữ mạng SAN với góc nhìn rằng những thứ này quá phức tạp, đắt và chậm. Những tính chất nói trên không phù hợp cho hệ thống dùng để phân tích Big Data vốn nhắm đến hiệu năng cao, tận dụng hạ tầng thông dụng và chi phí thấp. Ngoài ra, việc phân tích Big Data cũng cần phải được áp dụng theo thời gian thực hoặc cận thời gian thực, thế nên độ trễ cần phải được loại bỏ bất kì khi nào và bất kì nơi nào có thể.

Nguồn: Wikipedia, Intel, SAS